要約:

- OpenAIの人工知能ツールWhisperは、人間レベルの堅牢性と精度を持っていると謳っている。

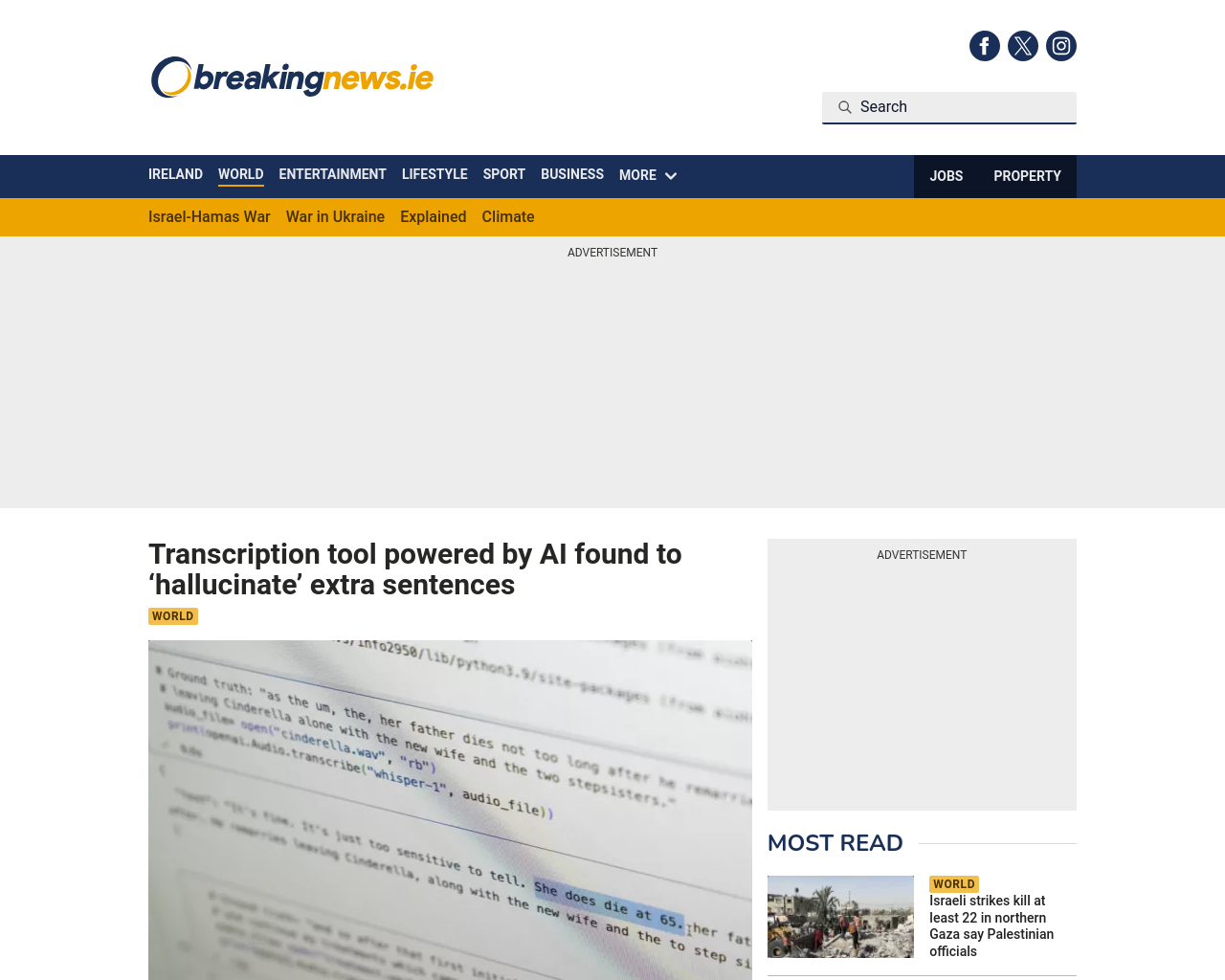

- しかし、Whisperには重大な欠陥があり、文章の一部または完全な文を捏造する傾向がある。

- 捏造されたテキスト(幻覚として知られる)には、人種的なコメント、暴力的な修辞、さらには想像上の医学的治療が含まれる可能性がある。

- 医療機関がWhisperベースのツールを利用して患者の医師との相談を転記することを急いでいるが、OpenAIは「高リスク領域」での使用を避けるよう警告している。

- 研究者やエンジニアは、Whisperの幻覚に頻繁に遭遇しており、数多くの録音で誤った転記が生じている。

感想:

Whisperが幻覚を生じるという問題は深刻であり、特に医療分野での誤解や誤転記は重大な影響を及ぼす可能性がある。OpenAIはこの欠陥に対処する必要があり、研究者たちの発見を取り入れることでモデルの改善を図るべきである。AI技術の使用は慎重に検討され、幻覚の発生を最小限に抑えることが重要であると考えられる。