- OpenAIのツールWhisperは、テキストをでっち上げる傾向にあると専門家が述べている。

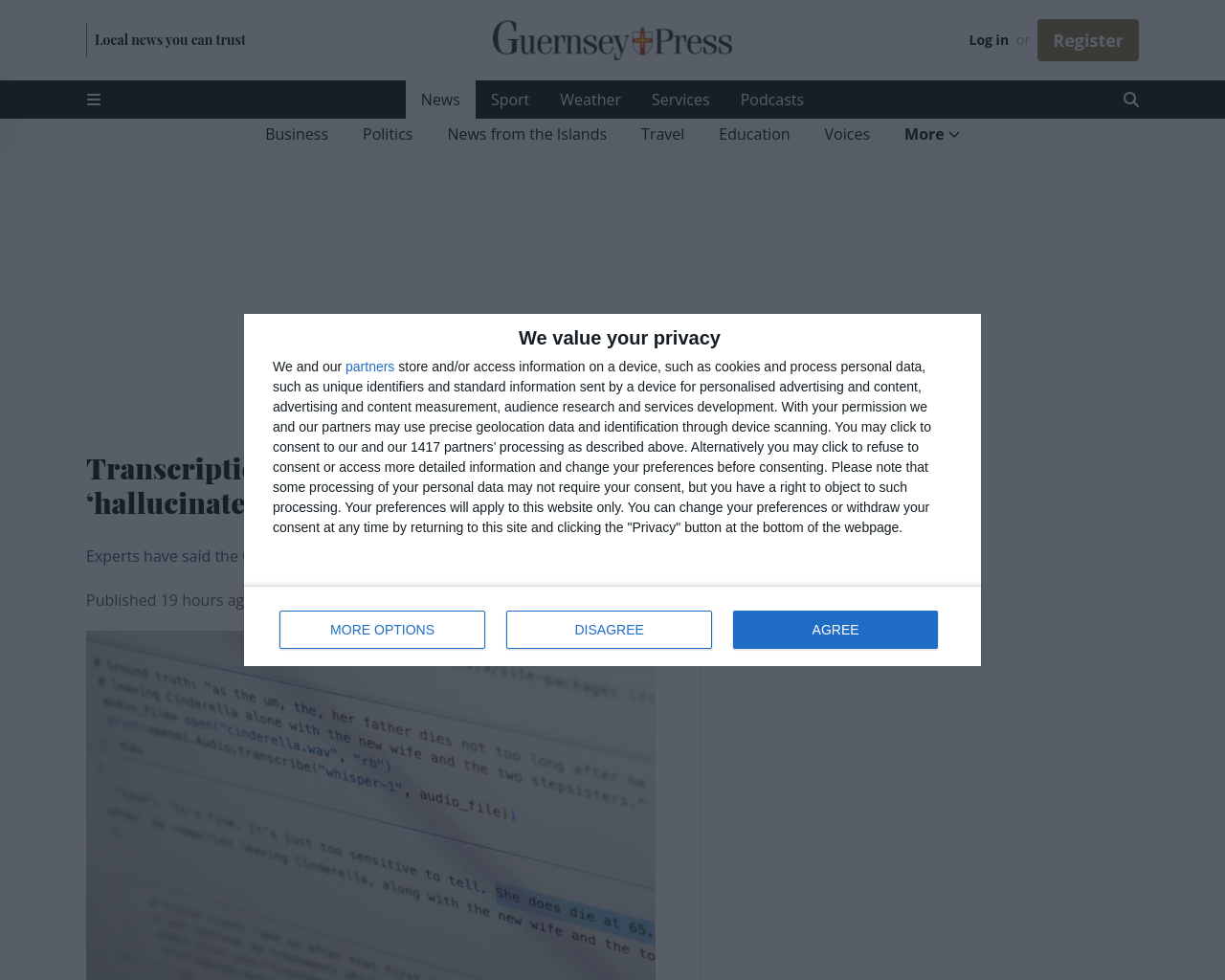

- Whisperは、人間のレベルに近い堅牢性と正確さを持つとOpenAIが主張しているが、完全な文章やテキストの一部をでっち上げる傾向がある。

- 業界では幻覚として知られるでっち上げテキストには、人種的なコメントや暴力的な修辞、さらには想像上の医療処置などが含まれる。

- Whisperの幻覚は、世界中のさまざまな産業で使用されており、インタビューの翻訳や転記、人気のある消費者技術でのテキスト生成、動画の字幕作成などに使用されている。

- 問題の全体像は明確ではないが、研究者やエンジニアはWhisperの幻覚に頻繁に遭遇している。

この記事では、OpenAIのWhisperがテキストをでっち上げるという問題が取り上げられています。Whisperは人間レベルの正確性を持つと主張されていますが、幻覚と呼ばれるテキストのでっち上げが頻繁に発生しているようです。この問題は様々な産業で使用されており、特に医療現場などで深刻な影響を及ぼす可能性があると指摘されています。専門家や元OpenAIの従業員たちは、AI規制を検討するよう連邦政府に働きかけています。OpenAIはこの問題に対処する必要があるとされています。