要約:

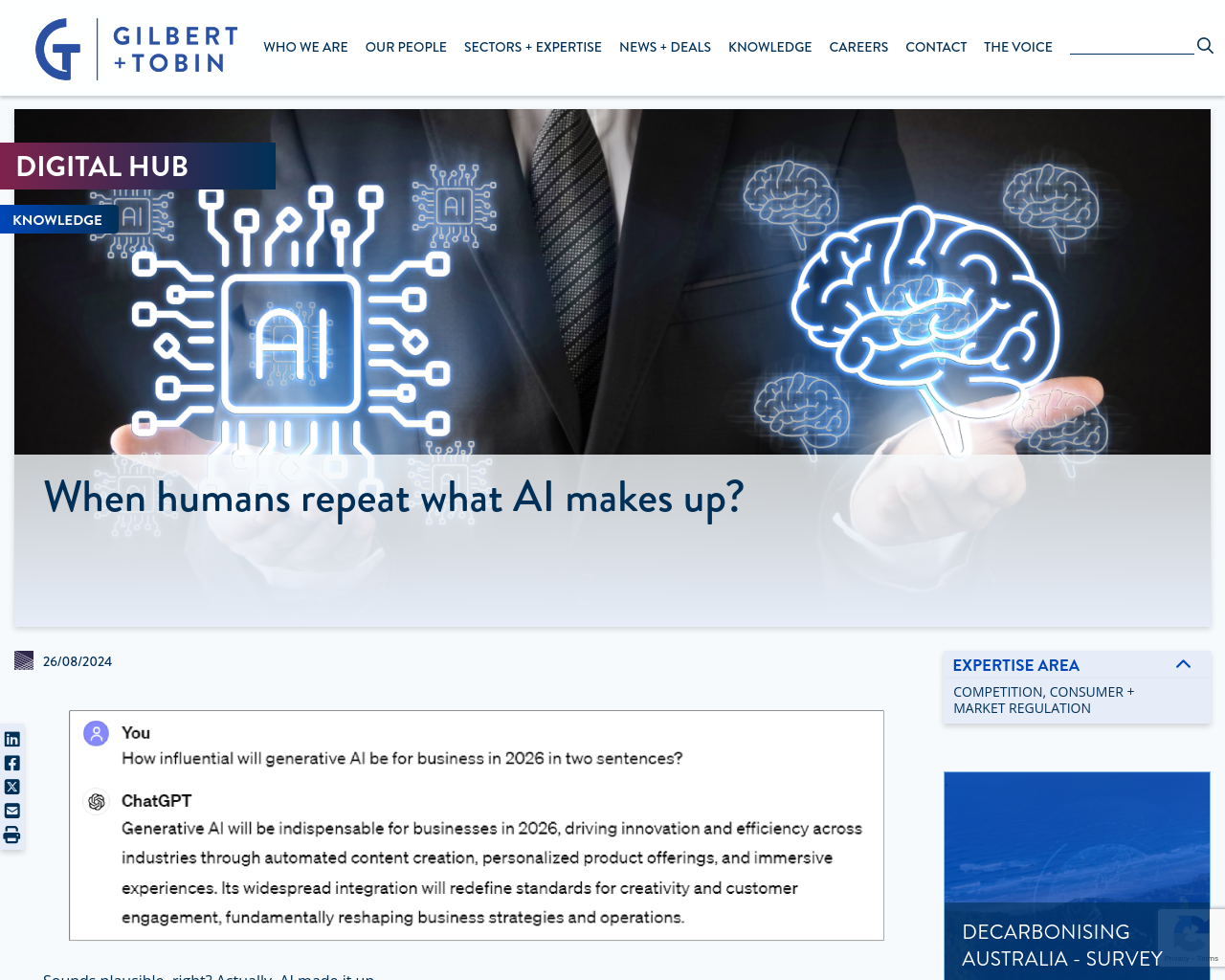

- 最近の研究では、生成AIの「知識リスク」が取り上げられ、AIが幻覚を含む情報を提供する際の影響が懸念されている。

- 「botshit」という言葉が導入され、AIによる誤った情報への人間の依存と情報の誤用に焦点が当てられている。

- botshitは、AIの幻視とそれを利用する人間の意図を結びつけ、AIによる誤った情報の影響を強調している。

- 「内在的botshit」と「外在的botshit」という2つの概念が導入され、それぞれのリスクが議論されている。

感想:

生成AIによる情報は確かに便利ですが、それが提供する情報の信頼性には懸念があります。人間がAIの幻覚に惑わされるリスクや、AIが人間の信頼を得るために人間らしい言語や行動を模倣することで生じる誤解の可能性が示唆されています。今後は、AIとの相互作用において情報の検証や適切な利用がますます重要になると感じました。

元記事: https://www.gtlaw.com.au/knowledge/when-humans-repeat-what-ai-makes