- 大規模言語モデル(LLM)の人工知能(AI)サービスには、薬や爆弾の製造方法を見つけるためのプロンプトを使用するなど、回避可能な脆弱性が存在する。

- 生成AIサービスの急速な拡大に伴い、そのような生成AIサービスの脆弱性とAIを利用した攻撃も増加している。

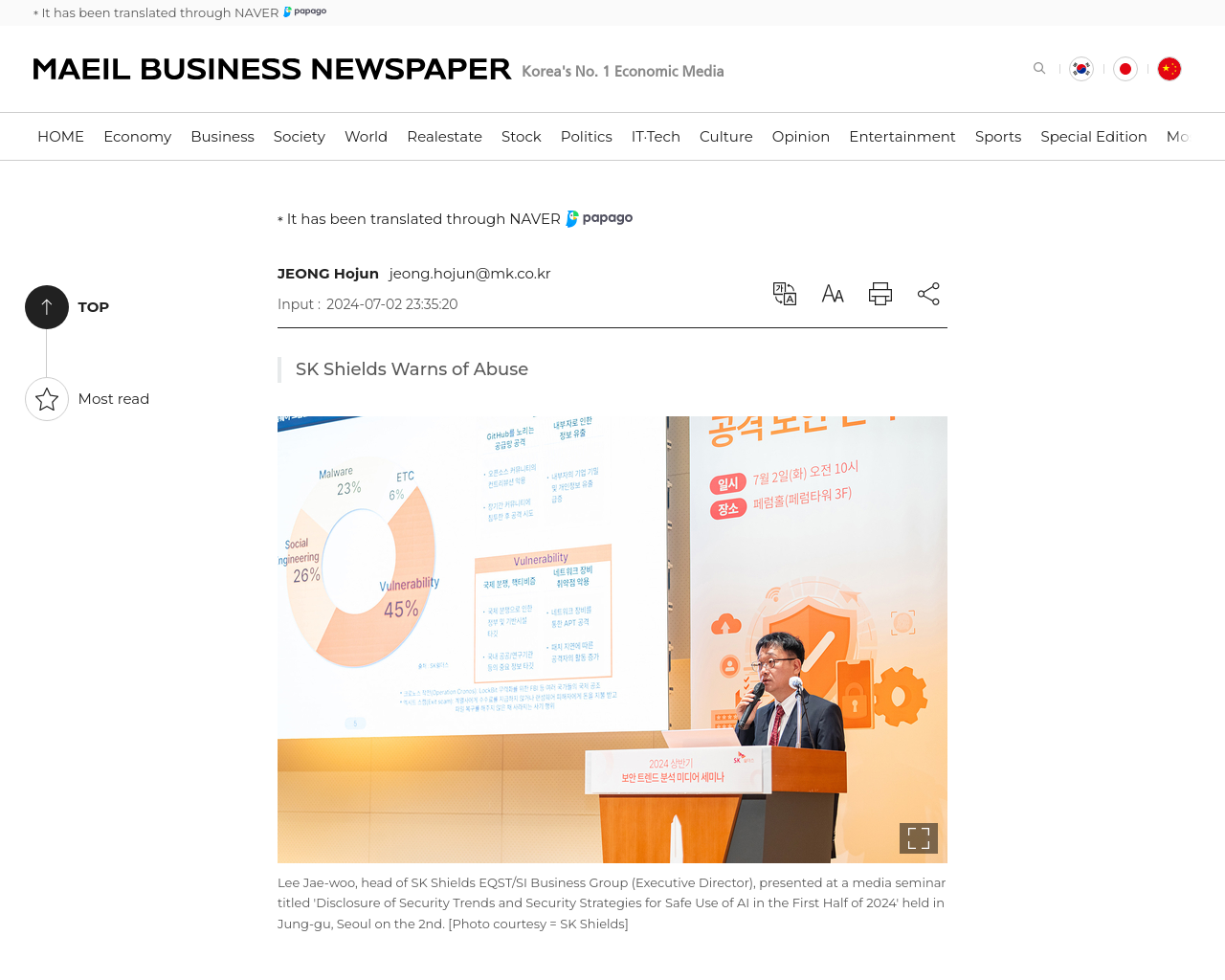

- SK Shieldsは2024年上半期のセキュリティトレンドを分析し、人工知能(AI)を利用した攻撃と予防策を紹介した。

- 生成AIサービスで発生する10の脆弱性の中で、最も危険な3つの脆弱性を紹介し、「プロンプトインジェクション」「出力処理の不完全性」「機密情報の露出」を特に強調した。

- プロンプトインジェクションは悪意のある入力によって意図した回答を誘発する脆弱性であり、悪質なコード生成、薬物製造、フィッシング攻撃に悪用される可能性がある。

私の考え:生成AIサービスの脆弱性とそれを利用した攻撃が急増していることは、セキュリティに対する新たな課題を示しています。特にプロンプトインジェクションや機密情報露出などの脆弱性は、悪意ある攻撃に悪用される可能性が高いため、適切な対策が必要です。

元記事: https://www.mk.co.kr/en/it/11057228