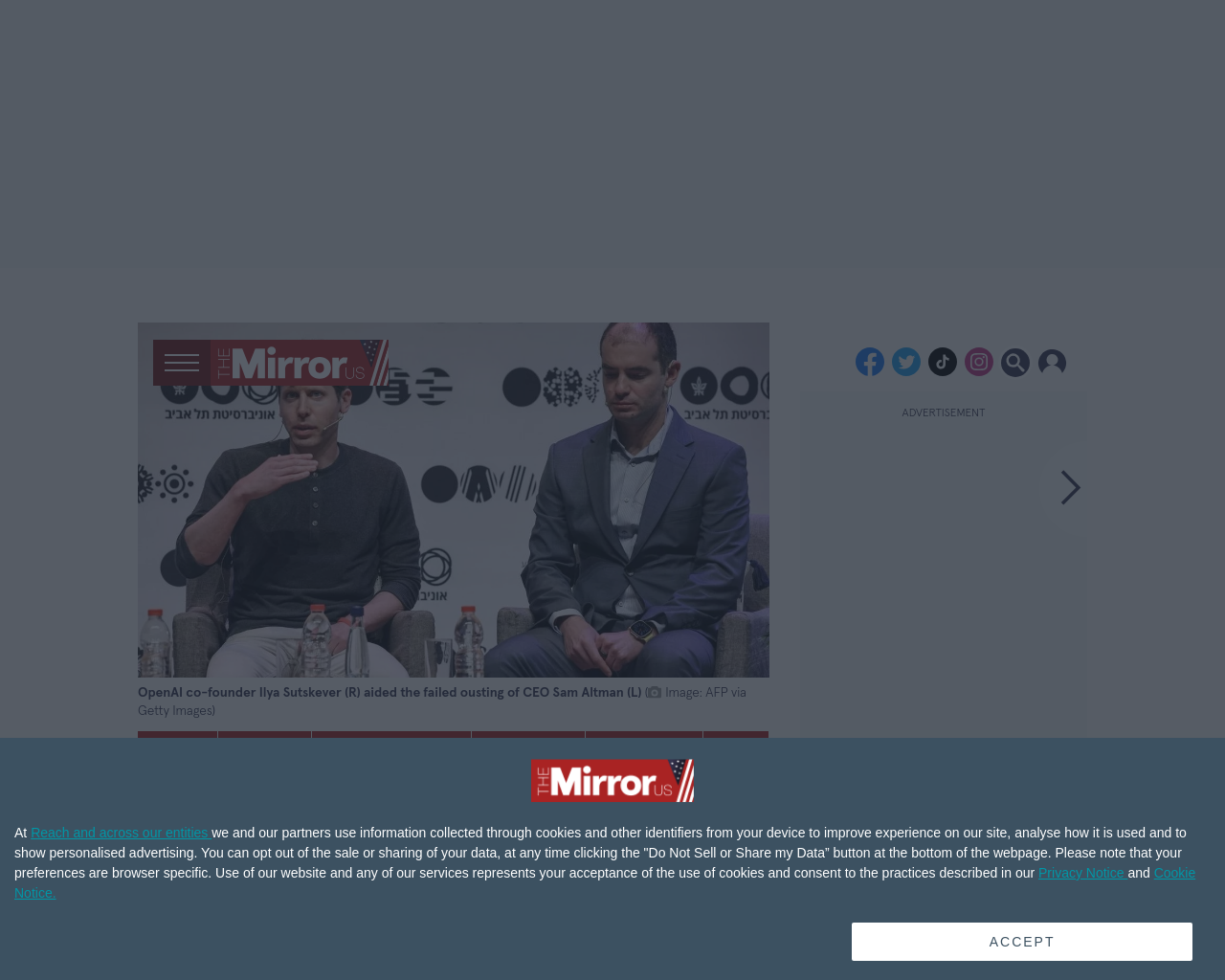

- OpenAIの共同創設者の一人であるIlya Sutskeverは、CEOのSam Altmanを退陣させようとした失敗した試みに関与していたが、安全重視の人工知能会社を立ち上げると発表

- Sutskeverは先月ChatGPTの製作者を離れた尊敬されるAI研究者であり、水曜日にソーシャルメディア投稿で、2人の共同創業者と共にSafe Superintelligence Inc.を立ち上げたことを明らかにした

- 会社は「短期的な商業的圧力から遮断された形で」安全性とセキュリティに取り組むとし、Superintelligence(人間の知能を超えるAIシステム)を安全に開発することを唯一の目的としている

- Safe Superintelligenceはパロアルト、カリフォルニア州、テルアビブにルーツを持つアメリカの企業であり、技術的なトップ人材を獲得できる能力を持つ

新しい会社がAIの安全性を重視し、商業的利益よりも安全原則を優先するという方針を打ち出していることは非常に重要です。Sutskeverらは、AIの進化と安全性を同時に進めることを強調し、安全性が常に先行するように取り組むことを約束しています。この動きは、AI企業が商業的利益を優先する傾向に対する元OpenAIスタッフの批判の中で行われており、AIの開発をオープンソースで行うという元の使命から逸脱していると非難されているOpenAIの別の共同創設者Elon Muskも同様の懸念を表明しています。

元記事: https://www.themirror.com/tech/tech-news/openai-founder-starts-superintelligence-ai-547899