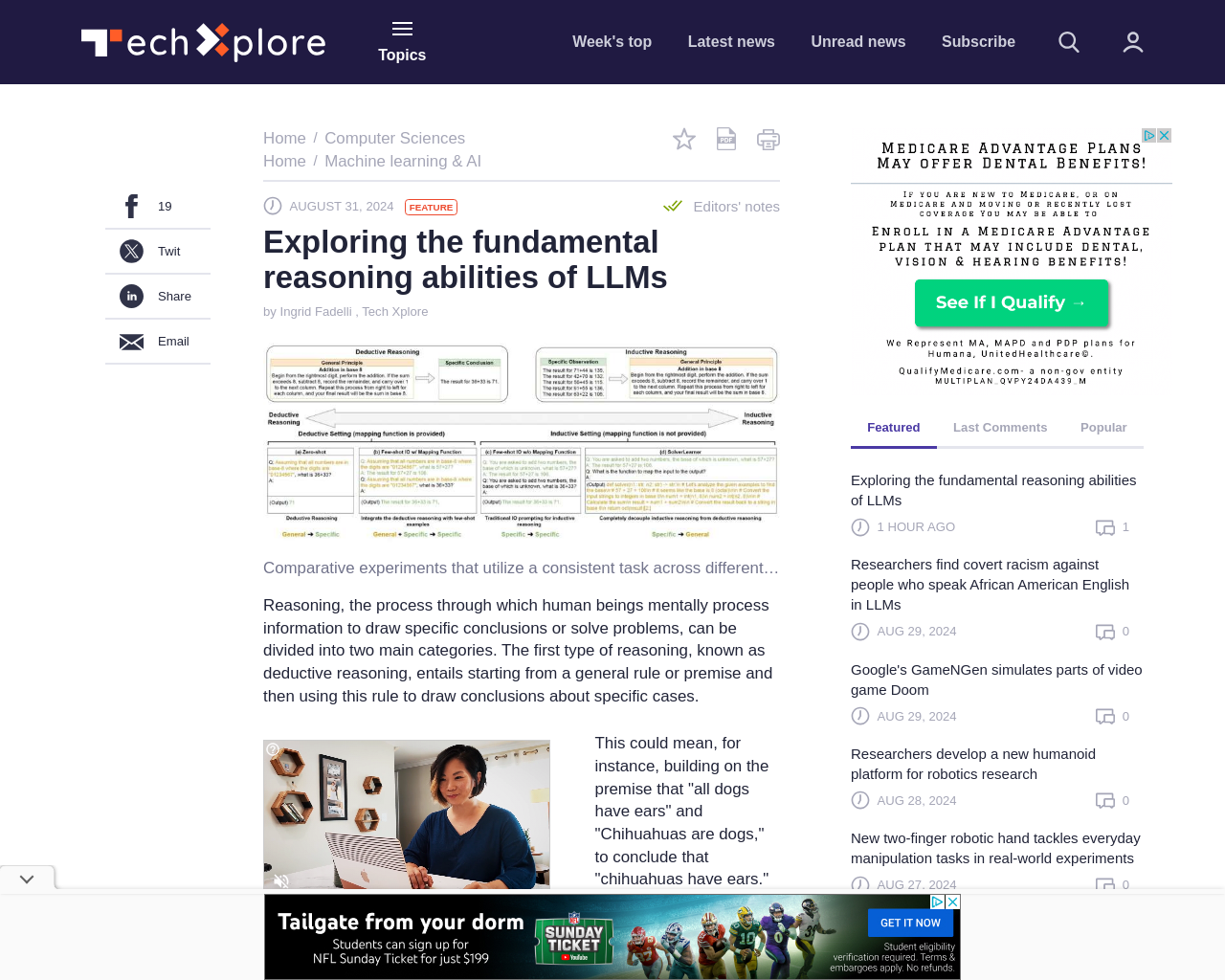

- 人間の推論プロセスは、演繹推論と帰納推論の2つに分けられる

- 過去の研究では、人間の推論能力を調査してきたが、AIシステムの推論戦略はあまり探究されていない

- AmazonとUCLAの研究チームは、大規模言語モデル(LLMs)の推論能力を調査し、帰紹推論よりも強い帰納推論能力を持つことを発見

- 研究では、新しいモデルSolverLearnerを導入し、帰納推論と演繹推論を明確に区別

- LLMsは帰納推論において優れた能力を示すが、演繹推論能力に欠けることが明らかになった

- LLMsの強力な帰納推論能力を活用することで、特定のタスクに取り組むAI開発者にインスピレーションを与える可能性がある

研究結果から、LLMsの推論プロセスをより理解し、今後のAI開発に生かすことが期待される。

元記事: https://techxplore.com/news/2024-08-exploring-fundamental-abilities-llms.html