- 大規模言語モデル(LLM)のプライバシーのリスクに焦点を当てる

- 企業でのLLMの導入に伴うプライバシーのリスク

- 企業がデータサイエンス/予測分析のパイプライン向けに設計したプライバシーフレームワークとコントロールをそのままGen AI/LLMのユースケースに適用する傾向がある

- 企業のプライバシーフレームワークをLLMの新しいプライバシーの側面を考慮に入れて適応させる必要がある

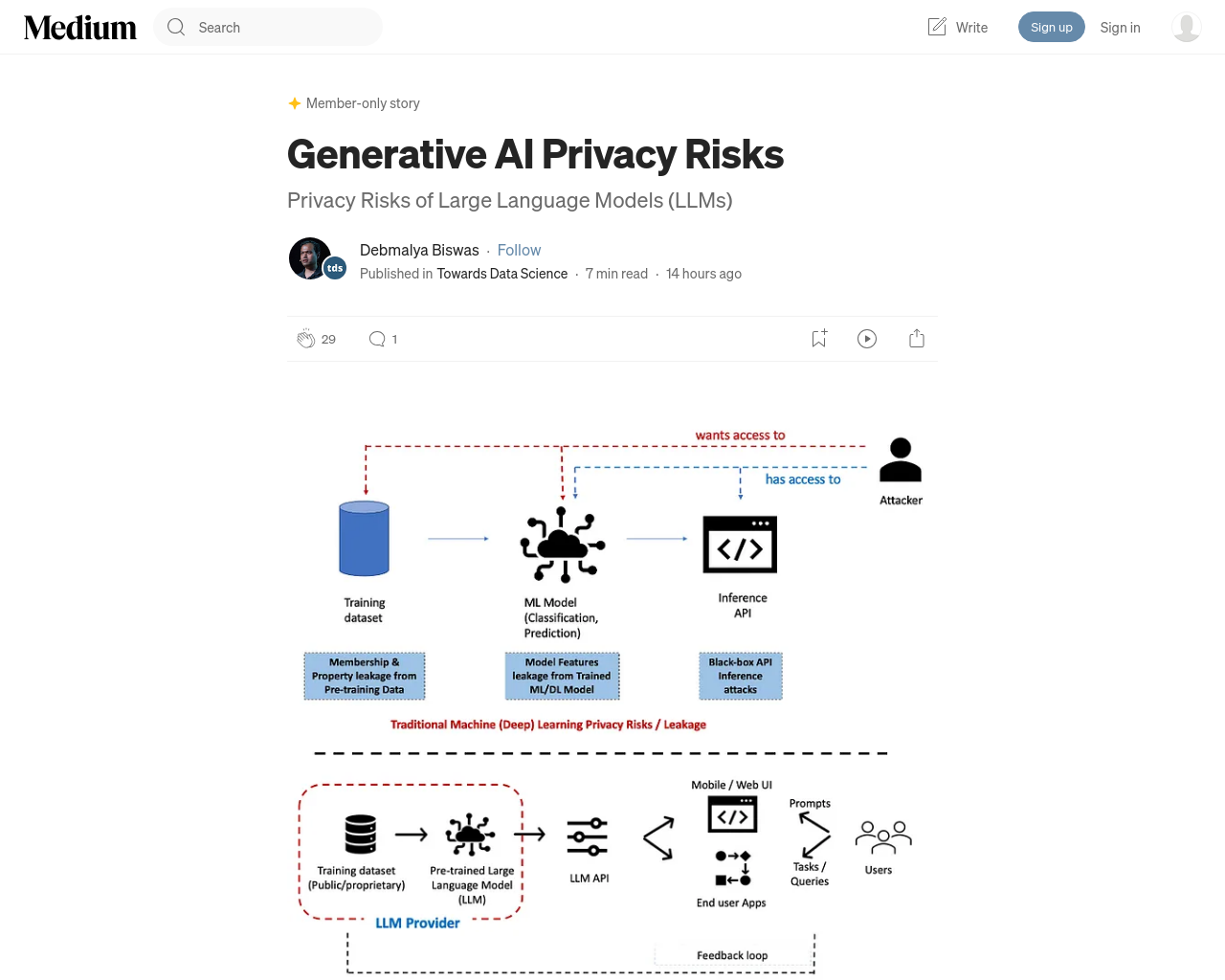

- 従来の教師あり機械学習コンテキストにおけるプライバシー攻撃シナリオを検討する

- AI/ML世界の大部分は予測や分類タスクを解決するために開発された機械学習(ML)/ディープラーニング(DL)モデルから成る

私の考え: プライバシー保護は重要であり、LLMのような新しい技術を取り入れる際には、従来のフレームワークを適応させる必要があることが示唆されている。企業はプライバシーリスクに対処するために新たなアプローチを取る必要があります。

元記事: https://towardsdatascience.com/generative-ai-privacy-risks-5983f2f594e4