- ExtraHopが行った調査では、世界中の1,200人のITおよびセキュリティリーダーが対象となり、組織内での生成AIツールの使用を保護および統括する計画を理解することが目的とされた。

- 調査結果によると、人工知能(AI)の禁止は機能しない。唯一残された選択肢は、技術の使用を許可し、保護のためのガードレールを設定することである。

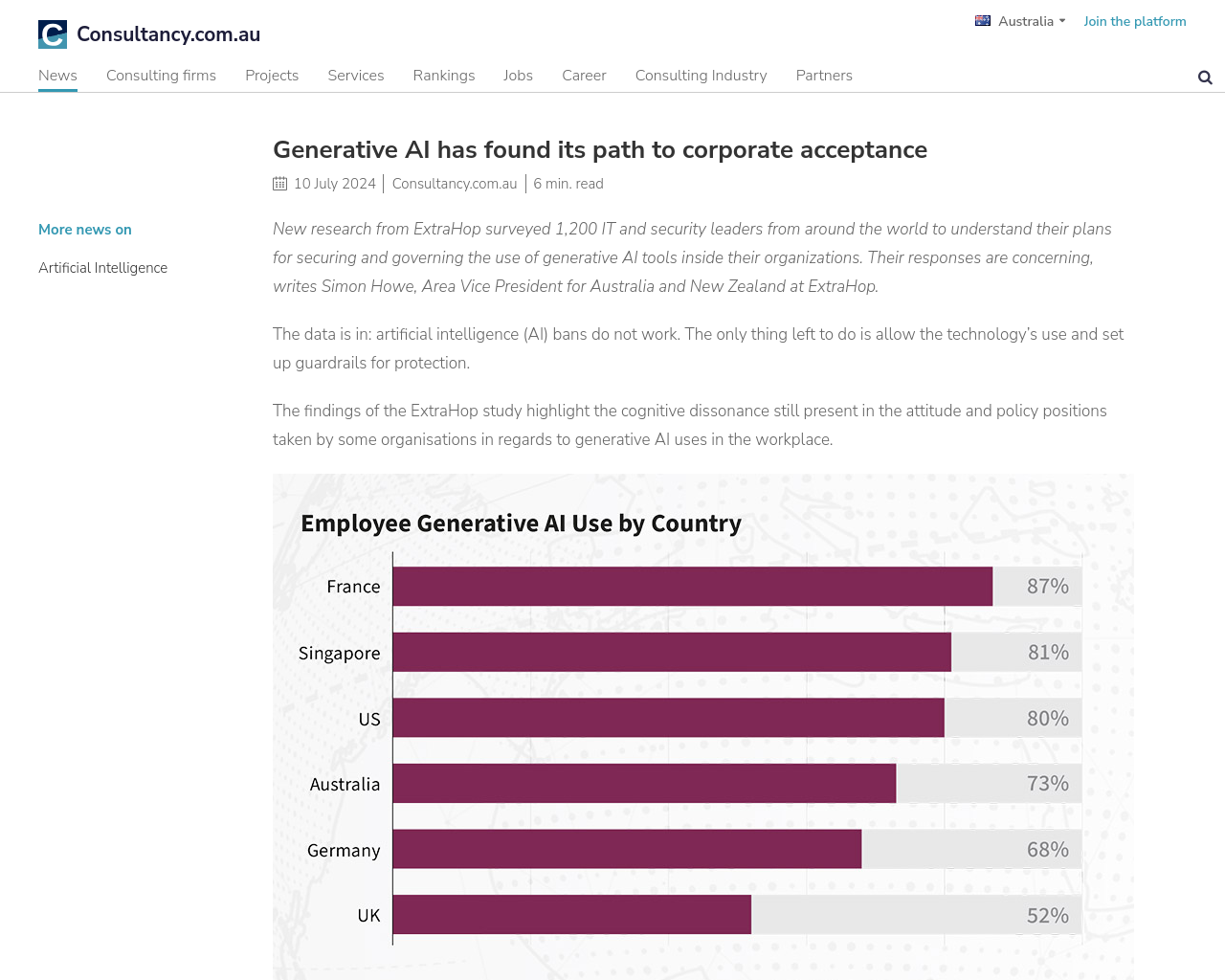

- 調査によれば、3分の1の組織が従業員に生成AIおよび大規模言語モデル(LLM)の使用を禁止しているが、そのうち5%の組織は従業員がツールを一切使用していないと述べている。

- 生成AIの職場での使用に関して、組織の方針はまだ不一致が見られる。

自分の考え:生成AIの使用に関する組織の方針や実際の使用の間に認識のずれがあることが明らかになっています。組織はリスクを最小限に抑えながら生成AIの恩恵を最大化する方法を模索しているようですが、バランスを取るのは容易ではないと感じられます。セキュリティポリシーの策定や従業員への適切な教育が重要であり、組織が生成AIを受け入れるためには適切な保護手段を設定する必要があると考えられます。