- 認知的不一致は、個人が2つ以上の矛盾する信念を持っているときに経験する精神的な不快感を表す心理学用語。

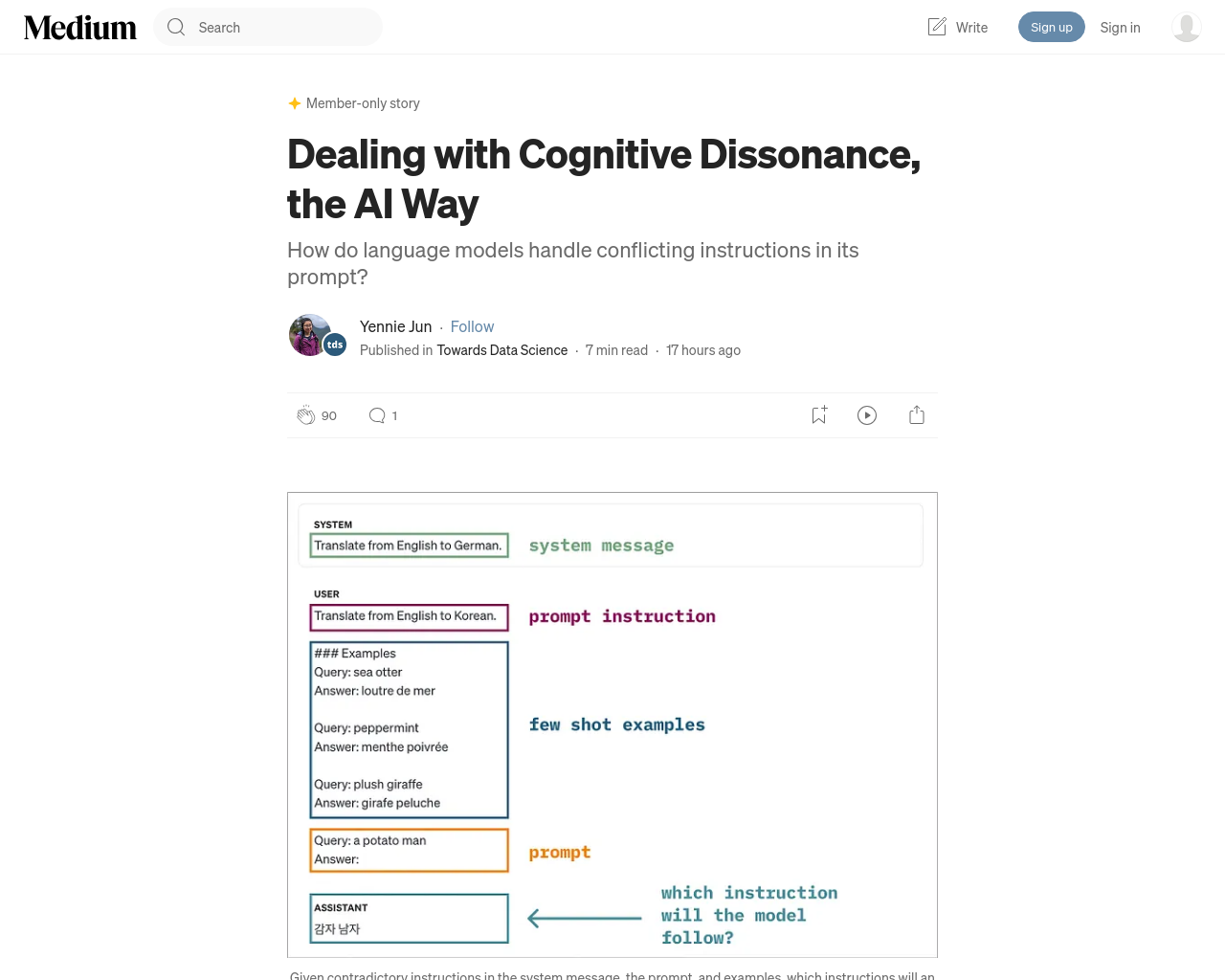

- 大規模言語モデル(LLM)は、矛盾する指示をどのように処理するかについての実験を行い、どちらの矛盾情報により一致する可能性が高いかを調査する。

- ユーザーは、LLMに何をするかを3つの方法で指示できる。

私の考え:この記事では、言語モデルが矛盾する指示をどのように処理するかに焦点を当て、実験を通じてどちらの情報に従う傾向があるかを明らかにしています。ユーザーは3つの方法でLLMに指示できることが示唆されています。

元記事: https://towardsdatascience.com/dealing-with-cognitive-dissonance-the-ai-way-1f182a248d6d