- 認知的不調和とは、個人が2つ以上の矛盾する信念を持つことで経験する精神的不快感を表す心理学用語

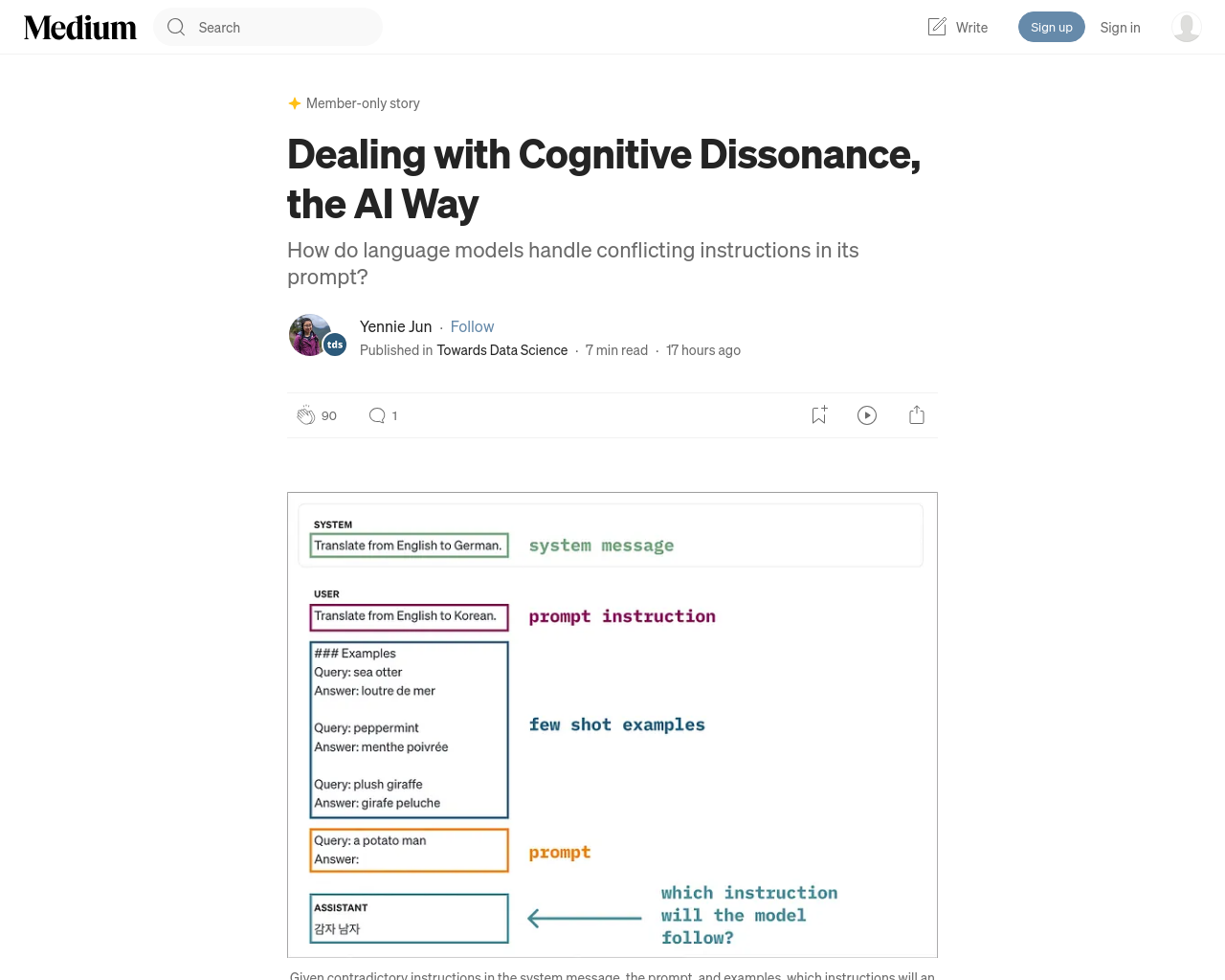

- 大規模言語モデル(LLM)は、矛盾する指示にどのように対処するかについて関心がある

- LLMに矛盾する情報を提供し、どちらの情報に合致するかを実験により調査

私の考え: 大規模言語モデルが矛盾する指示をどのように処理するかについての研究は興味深いです。矛盾する情報を与えて、モデルがどちらの情報に合致するかを調査する実験は、モデルの動作や意思決定プロセスを理解する上で重要な洞察を提供する可能性があります。

元記事: https://towardsdatascience.com/dealing-with-cognitive-dissonance-the-ai-way-1f182a248d6d