- GPT-3はGenerative pre-trained Transformer modelの3番目のイテレーションで、Open AIが作成したモデル。

- BERTはGoogleによって作成された大規模な言語モデルで、自然言語処理の様々な活動に使用される。

- RobertaはBERTモデルの改良版で、Facebook AI Researchによって開発された。

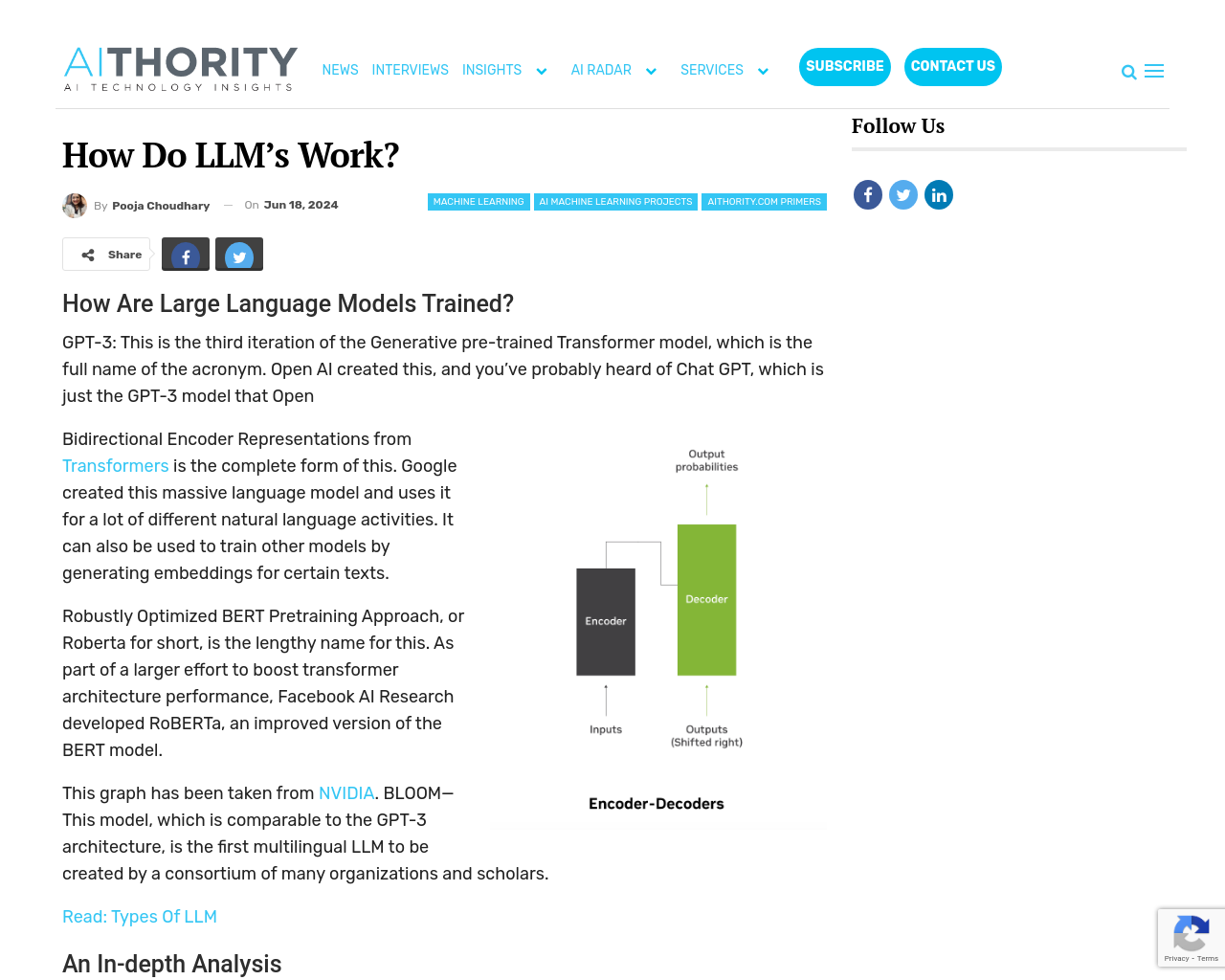

- BLOOMはGPT-3アーキテクチャに類似した最初の多言語LLM。

- LLMはトレーニングと推論の2つの部分から成る。

- LLMはトークン化されたテキストデータから事前トレーニングを受け、特定の活動やドメインにファインチューニングされる。

- LLMは推論を行い、入力コンテキストと学習した知識を使用して適切な解決策を生成する。

- LLMは文脈を捉え、自然な応答を生成するためにビームサーチなどの手法を使用する。

- LLMは言語パターンを理解し、人間らしい応答を生成するために大量のテキストデータを処理する。

LLMは自然言語の理解、生成、翻訳などのアプリケーションを可能にするために、深層学習技術を使用して単語のシーケンスを分析し、一貫したテキストを予測・生成する。

私の考え:LLMの技術は自然言語処理の分野において非常に重要であり、テキストデータの処理や応答生成に革新をもたらしています。特に、ビームサーチやトークン化などの手法を使用して、人間らしい応答を生成する能力は注目に値します。また、LLMのトレーニングおよび推論のプロセスについての理解を深めることで、AI技術の進化を促進できる可能性があります。

元記事: https://aithority.com/machine-learning/how-do-llms-work/